在家也能自制?人手一個ChatGPT的時代即將到來

隨著人工智能技術的飛速發展,尤其是以ChatGPT為代表的大語言模型的崛起,AI正以前所未有的速度融入日常生活。如今,一個全新的趨勢正在悄然形成:通過人工智能基礎軟件開發,普通人或許也能在家中搭建自己的智能助手,開啟“人手一個ChatGPT”的個性化AI時代。

一、技術民主化:AI開發的平民之路

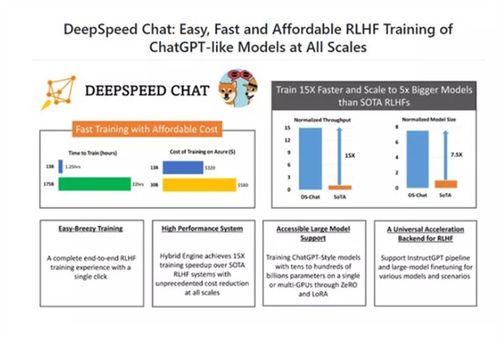

過去,開發強大的人工智能模型需要龐大的算力、海量的數據以及頂尖的科研團隊,門檻極高。開源社區和基礎軟件工具的進步正在改變這一局面。例如,Meta開源的Llama系列模型、以及Hugging Face等平臺提供的豐富資源,讓開發者甚至愛好者能夠基于預訓練模型進行微調、定制,從而以相對較低的成本創建專屬的AI應用。

基礎軟件開發框架(如TensorFlow、PyTorch)的易用性不斷提升,加上云計算服務提供了靈活的算力支持,個人在家中利用普通電腦或租賃云端GPU進行模型訓練和部署已成為可能。這意味著,AI開發不再只是科技巨頭的專利,正逐步走向“民主化”。

二、個性化需求催生“自制AI”浪潮

通用AI助手如ChatGPT雖然強大,但未必能滿足每個人的特定需求。無論是專業領域的知識問答、個性化的創作風格,還是私有數據的處理,人們越來越希望擁有一個完全適配自身場景的智能伙伴。通過基礎軟件開發,用戶可以根據自己的數據訓練模型,打造一個更懂自己、更專注、且能保護隱私的專屬AI。

例如,作家可以訓練一個熟悉自己文風的協作助手,程序員可以構建一個針對特定代碼庫的調試顧問,而教育工作者可能開發一個貼合課程內容的答疑機器人。這種高度定制化的AI,其價值在于深度適配與可控性,這正是通用模型難以完全覆蓋的。

三、挑戰與門檻:理想與現實的距離

盡管前景令人興奮,但要實現真正的“人手一個”,仍面臨不少挑戰。技術門檻雖在降低,但模型訓練、調優和部署仍需要一定的機器學習知識和編程能力,對普通用戶而言并非毫無障礙。成本問題不容忽視:高質量的微調需要精心準備的數據集,而訓練過程可能消耗可觀的算力資源,即使利用云端服務,長期運行也可能是一筆開支。

倫理與安全問題隨之而來。個人開發的AI若未經過妥善的倫理對齊,可能會產生偏見輸出或安全漏洞;而私有數據的處理也必須謹慎,防止泄露。因此,未來的基礎軟件開發工具可能需要集成更多易用性設計和安全規范,以降低風險。

四、未來展望:生態共建與全民共創

“人手一個ChatGPT”或許不會以每個人都從零開始編碼的形式出現,而更可能是一個分層、協作的生態系統。基礎軟件平臺可能會提供更加圖形化、模塊化的開發界面,讓用戶通過“拖拽”和配置就能組合AI功能。科技公司或社區可能推出“AI應用商店”,共享微調后的模型模板,用戶可以像下載APP一樣,選擇并個性化自己的AI助手。

開源文化與共享精神將加速這一進程。開發者貢獻的工具、教程和預訓練模型將持續降低入門門檻,形成全民參與、共同創新的良性循環。教育領域也可能逐步引入AI開發基礎課程,培養更多人的相關技能。

###

人工智能基礎軟件開發的進步,正將AI從神壇帶入尋常百姓家。雖然完全實現“在家自制”且人人皆可輕松擁有專屬ChatGPT仍需時日,但技術演進的軌跡已清晰指向一個更加個性化、民主化的AI未來。這個時代并非遙不可及,它需要技術創新、工具完善與社區共建的共同推動。當每個人都能塑造屬于自己的智能伙伴時,人機協作的深度與廣度將迎來革命性的拓展,真正開啟智能生活的新篇章。

如若轉載,請注明出處:http://m.tianyu11.cn/product/49.html

更新時間:2026-01-05 17:14:26